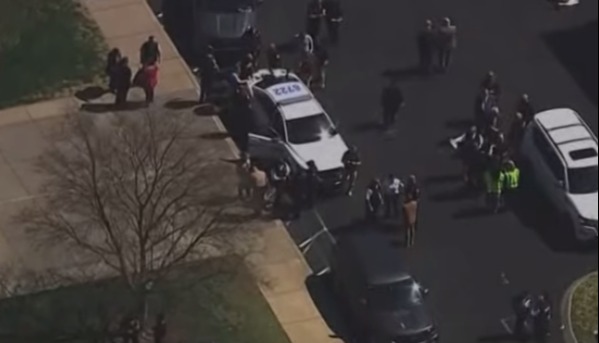

AI誤判薯片為槍 美國16歲高中生遭警察包圍香港新聞網10月27日電 據外媒26日報道,近日,美國馬里蘭州一名16歲高中生因口袋里的薯片包裝袋被學校AI監控系統誤判為槍支,遭警方包圍並且短暫逮捕。這一“烏龍事件”不僅讓當事人陷入恐慌,更引發公眾對校園AI安防系統可靠性及倫理風險的廣泛討論。 事件經過:薯片袋觸發“槍支警報” 警方緊急出動 據福克斯新聞26日報道,事件主角為馬里蘭州某高中16歲學生塔基·艾倫。事發時,艾倫在學校等車,將一個空薯片包裝袋塞進外套口袋。不久後,多名警察突然持槍包圍他,命令其趴下並戴上手銬。 執法記錄儀視頻顯示,警方最初依據學校實時監控AI系統的警報行動,但隨後確認是系統誤判——原本檢測到的“疑似槍支影像”實為一包薯片。艾倫回憶:“當時大概八輛警車衝過來,警察舉槍大喊‘趴下’。我舉起雙手,完全懵了,心想‘到底發生了什麼?’”最終,警方確認無威脅後解除控制,但事件已在校園引發震動。

ABC新聞報道視頻截圖。 誤判溯源:AI系統“漏判”+ 人工跟進疏漏 警方事後調查顯示,誤判源於學校部署的AI安防系統。該系統由Omnilert公司開發,主打“校園主動射擊檢測”,通過實時分析監控畫面識別槍支形狀併發出警報。儘管人工審查員已將該次警報更新為“無威脅”,但校長未注意到這一修正信息,仍通知校園安全小組啟動應急響應,最終觸發警方出動。 Omnilert公司在聲明中致歉,稱“對事件深感遺憾”,但強調系統“整體流程符合設計”,僅因“現實場景中槍支檢測環境複雜”導致誤報。該公司透露,其AI系統宣稱準確率高達99%,已在美國數百所學校安裝,但批評者指出,日常物品(如鑰匙、錢包)常因光線、角度問題被誤判,此次薯片袋事件正是典型。

ABC新聞報道視頻截圖。 同類事件頻發:AI安防的“狼來了”困境 此次事件並非孤例。2024年,佛羅里達州一所學校AI系統曾將學生背包誤判為槍支,引發全校疏散;加州另一案例中,AI將玩具槍照片誤報,導致警方封鎖校園。這些事件暴露出校園AI安防的兩大痛點:一、技術局限性:AI依賴圖像識別,對非標準形態物品(如褶皺的薯片袋、玩具槍)易產生誤判;二、流程漏洞:人工審核與系統警報的銜接不暢,導致“誤報-過度響應”鏈條難以切斷。 社會反響:家長呼籲加強AI審核 避免信任透支 事件曝光後,社交媒體湧現大量討論。家長們擔憂:“如果孩子帶個玩具或零食都被當威脅,未來真遇到危險時,警方還會當真嗎?”教育專家則指出,頻繁誤報會削弱AI系統的可信度,形成“狼來了”效應,反而威脅校園安全。 艾倫本人表示:“薯片袋不該被當成槍。”他希望事件能推動學校改進AI系統,“至少應該讓人工審核更及時,避免類似烏龍。”目前,Omnilert公司已承諾優化警報復核機制,但如何平衡“安全”與“誤判”,仍是校園AI應用的核心課題。(完) 【編輯:關秀英】

|